ソニーは2025年1月、空間コンテンツ制作を支援するソフトウェアおよびハードウェアが統合されたソリューション群「XYN™ 」(ジン)を発表した。今年に入り、同社はXYN Motion Studioやmocopi、空間再現ディスプレイなどを通じて、3DCGを取り扱う幅広い業界の企業やクリエイターに対し、高品位かつ効率的なコンテンツ制作支援を一気に加速させてきた印象を受ける。

そしてInter BEE 2025期間中の2025年11月19日、ついに放送関係者などのうち、所定の環境条件を満たすユーザーを対象に、「XYN 空間キャプチャーソリューション」のベータ利用に関する問い合わせ受付が開始された。本ソリューションは2025年1月の時点で製品の存在自体は明かされていたものの、外部への提供は行われていなかった。それが今回、ようやくその門戸が開かれた形となる。

プロトタイプを超えた「実用」の確信。独自のアルゴリズムが高精細な空間再現を実現

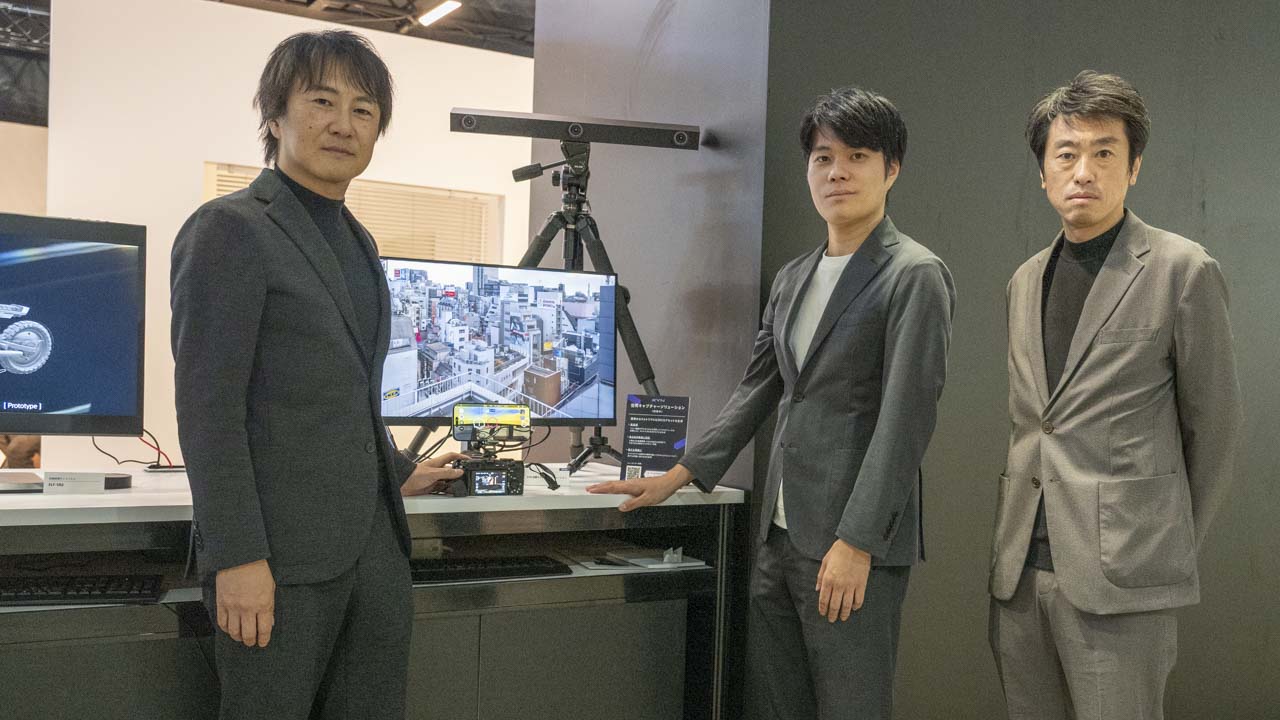

Inter BEE 2025のソニーブースで披露されたソニーの太田佳之氏やソニーPCLの伊藤隆嗣氏の言葉からは、この技術が単なるプロトタイプを超え、実用段階に入った確かな手応えが感じられた。XYN空間キャプチャーソリューションは、複数の写真から空間を3DCG化する技術であり、この1年間、パートナー企業や顧客との対話を重ねて開発が進められてきたという。

ブースでは、実際にバーチャルプロダクションの背景映像として使用された、渋谷の屋上から撮影した風景の3Dモデルが紹介された。これは単なるパノラマ写真ではなく、空間そのものが生成されているため、バーチャルカメラのアングルを変えてもパースが破綻せず、自然な見え方を維持している。ここまでの高精細なシーン再現が可能になっている点は、独自のアルゴリズムによる成果であり、プロフェッショナルの現場で求められるクオリティに十分に耐えうるものだと開発陣は自信を覗かせる。

具体的なワークフローは、ソニーのミラーレス一眼カメラ「α」と、専用のスマートフォン向けナビゲーションアプリを組み合わせて行われる。特筆すべきは、専門知識がないユーザーでも扱えるように設計されたナビゲーション機能だ。アプリ上のガイドに従ってマーカーを合わせるだけで自動的にシャッターが切られ、撮影されたエリアは画面上で色が変わり視覚的に認識できる。

「どこが撮れていて、どこが撮れていないか」が一目瞭然となるため、効率よく、かつ失敗のないデータ収集が可能となる。ソニーがハードウェアからソフトウェアまでトータルで提案することで、高品質な空間コンテンツ制作のハードルを下げようとする意図が明確に見える。

CESから遂げた「3つの進化」。反射物や極細線の再現、そして専用レンダラーの提供

本ソリューションは、2025年1月のCES発表時から大きく3つの点で進化を遂げているという。1つ目は画質の向上だ。従来の手法では生成が難しかった反射物や透明な物体、あるいは電線や金網といった細い被写体の形状もしっかりと保持できるようブラッシュアップされた。また、数百インチ規模のCrystal LEDのような大画面で表示しても解像度不足を感じさせず、ノイズもほとんど目立たないレベルに仕上がっている。スマートフォンやPC画面では綺麗に見えても、原寸大のスタジオセットで表示すると粗が目立つといった既存技術の課題を克服し、フォトリアリスティックな3DCGとして実用可能な品質を実現している。

2つ目はナビアプリの再設計だ。プロトタイプ段階では操作性に課題があったアプリをゼロから見直し、フォトグラメトリなどの撮影に不慣れなユーザーでもミスなく撮影できるよう大幅な改善が施された。3つ目は専用レンダラーの提供である。Unreal Engine上で高品質なアセットを再生する際にソニー製レンダラーを使用することで、HDR対応や解像度の最適化、微調整などが可能になり、アルゴリズムの性能を最大限に引き出せるようになった。もちろん他社製レンダラーでも表示は可能だが、ソニーPCL以外のスタジオや映像制作関係者にも商品としてリリースできる状態にまで完成度が高められている。

実際にソニーPCLの「清澄白河BASE」では、本技術を用いた撮影が行われている。事例として紹介されたアーティスト「Ooochie Koochie」のミュージックビデオ制作では、広島のロケ地十数カ所を撮影し、スタジオのLEDウォールに投影して撮影が行われた。多忙なアーティストを現地に連れて行くことなく、スタジオ内で現地さながらのクオリティの高い映像を短時間で撮りきることができ、監督からもその品質やUnreal Engineでの再生能力について高い評価を得ているという。具体的なデータ量の目安としては、ある夕景のシーンでは約150枚の写真を10分程度で撮影している。これは日が沈むまでの限られた時間内での撮影だったが、ナビアプリを活用することで迅速な撮影が可能であった。生成時間はプロトタイプ段階では3時間以上かかっていたが、ベータ版リリース時には1時間強程度に短縮される見込みだという。

まずは業界の活性化から。将来的な商用化を見据えつつ、今はフィードバックを募るフェーズへ

今回のベータ版公開にあたり、ソニー側は「ツールだけで利益を上げようとは考えていない」という姿勢を強調している。狙いは、空間コンテンツを作れるクリエイターを増やし、XR業界全体を盛り上げることにある。コンテンツが増え流通することで、結果としてディスプレイやヘッドマウントディスプレイといったハードウェアのエコシステム全体に波及することを目指しているのだ。そのため、現時点では無償でツールを開放し、広くフィードバックを募る形をとっている。将来的な商用化の際には有償化も検討されているが、まずはクリエイターにツールを行き渡らせることを優先している点は、業界の活性化を牽引する立場としての気概を感じさせる。

興味深いのは、動作推奨環境としてカメラには「α」、スマートフォンには「iPhone」が挙げられている点だ。ソニー製である「Xperia」ではなく他社製端末が推奨されることには驚きを覚えるが、これは市場シェアやユーザーの利用実態、動作安定性を考慮した現実的な判断だという。

もちろん、3D生成自体は他社製カメラのデータでも可能であり、Unreal Engine以外の環境への対応も順次進めていくというオープンな姿勢も示されている。あくまでクリエイターのワークフローに寄り添うことを第一義としているようだ。そうした柔軟な姿勢を含め、今回の空間キャプチャーソリューションのベータ公開は、バーチャルプロダクションにおける背景制作の課題を解決する重要な一手となりそうだ。

![ブラックマジックデザイン、DaVinci Resolve 21のFusionページにツール群「Krokodove」を統合 [NAB2026展示レポート]](https://jp.pronews.com/wp-content/uploads/2026/04/NAB-report_BMD_fusion_topoVQpHKAM-560x410.jpg?crop=1)

![ブラックマジックデザイン、ライブ用ミキサー「Fairlight Live」を公開。ATEMをオーディオI/Oとして活用 [NAB2026展示レポート]](https://jp.pronews.com/wp-content/uploads/2026/04/NAB-report_BMD_Fairlight_top02fS5Xxl-560x410.jpg?crop=1)

![ブラックマジックデザイン、DaVinci Resolve 21に「Photoページ」新設。RAW現像からテザー撮影までを統合[NAB2026展示レポート]](https://jp.pronews.com/wp-content/uploads/2026/04/NAB-report_BMD_fotopage_top-560x410.jpg?crop=1)