NHK放送技術研究所(以下、技研)は、5月29日から6月1日までの4日間、「技研公開2025」を開催した。

本年の技研公開は「広がる つながる 夢中にさせる」をテーマとしている。これは、メディアの視聴デバイスや視聴環境の多様化に伴い、人、コンテンツ、そして社会との連携が深まることを企図したものだ。技研は、これにより、実物感や没入感に満ちた新時代のメディア体験を提供し、多くの人々を魅了することを目指している。会場では、技研が掲げる長期ビジョン「Future Vision 2030-2040」に基づき、未来の放送メディアを実現するための研究成果18項目が公開された。

視聴体験が空間的、感覚的に拡張する未来

技研公開2025では、「イマーシブメディア」「ユニバーサルサービス」「フロンティアサイエンス」「メディアを支える技術」の4つのカテゴリーに分けて展示が行われた。

最初にイマーシブメディアコンテンツから紹介する。エントランスに設置された「広がるコンテンツ体験」は、来場者が最初に体験するイマーシブメディアの展示である。この展示は、従来の視覚と聴覚に加えて多感覚を活用することで、新たな視聴体験を提案した。

具体的には、ARグラスを装着し、遠隔地の知人と同一番組を視聴しながらコミュニケーションを楽しむ形態が示された。また、3Dディスプレイで表示されるコンテンツに対し、手持ちのデバイスから振動、温度変化、香りといった多感覚提示を行う装置も紹介された。

これらの技術を通じて、未来のコンテンツ体験の一端が実演形式で提示された。遠隔地の知人との同時視聴や、視覚・聴覚に加え触覚や嗅覚なども活用したコンテンツ形態は、今後のメディアの可能性を示唆している。

30K360°カメラと半球表示装置による没入感

高精細な360°映像と、ヘッドマウントディスプレイを必要としない没入型視聴環境が紹介された。

具体的には、今回新たに開発された画素数30Kの360°カメラで撮影された実写映像が、同じく新開発の15K相当プロジェクターを用いた半球スクリーン装置に投影された。この半球スクリーン装置は、現行のヘッドマウントディスプレイが持つ解像度の限界を克服する仕様で、360°ではないものの、広範囲にわたる没入感の高い映像体験を提供する。

さらに、立体音響も同時に提示され、視聴者はより臨場感のあるコンテンツを楽しむことが可能となる。この展示は、高精細な映像と音響を組み合わせることで、新たな没入型メディア体験の可能性を示唆した。

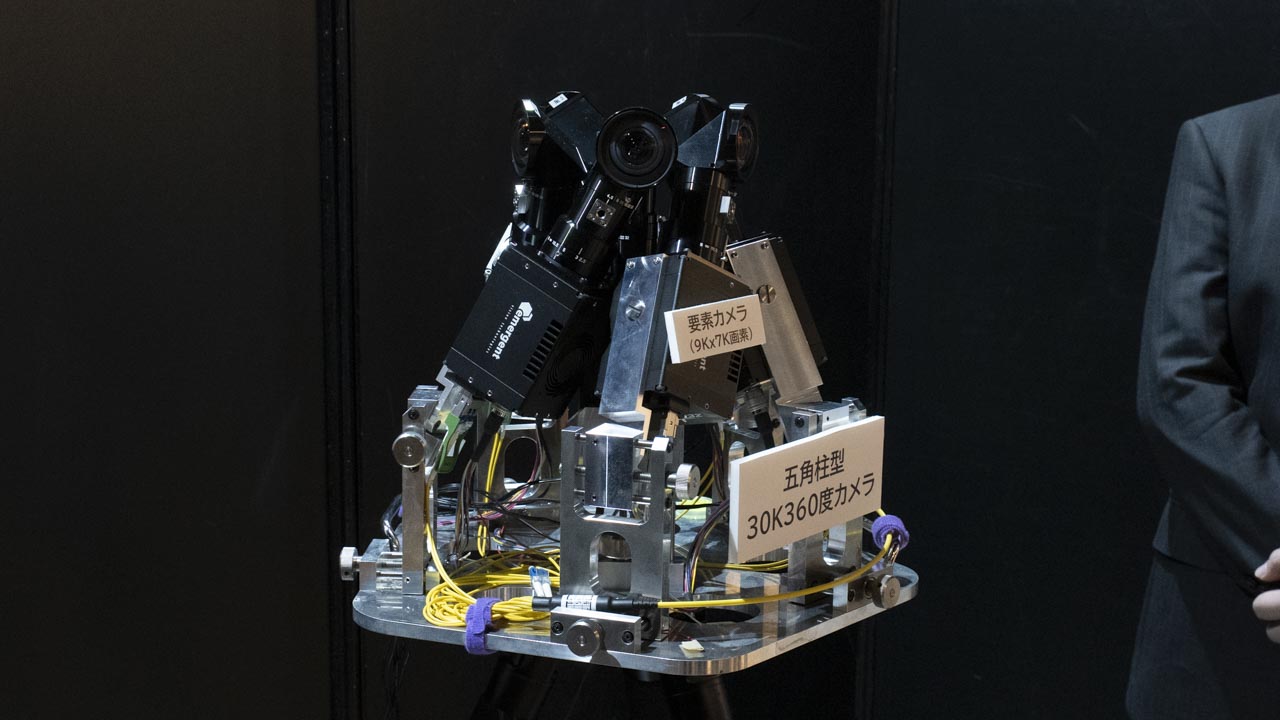

同じコーナーでは、30K360°カメラシステムの展示も行われた。

この30K360°カメラシステムは、9K×7K(9344×7000画素)の産業用カメラを6台使用する。各カメラで撮影された映像は、専用のワークステーション6台に光ケーブル(100ギガイーサ6本分)を介して伝送され、収録される。収録されたファイルは、後処理で「Mistika」を用いて30Kの1枚絵に合成される。

上映コンテンツの撮影に際しては、バッテリーを電源とするワークステーションとカメラが使用された。この電力供給方式により、バスや船といった移動体での撮影も可能となった。また、ワークステーションとカメラを接続する光ケーブルは最大150mまで延長可能であり、撮影における自由度を確保している。

カメラは通常の360°カメラとは異なり、斜めに配置されている。これは、複数の要素カメラで全天球映像を撮影する際、カメラ間の距離を極限まで近づけ、視差(パララックス)を最小限に抑えるためである。筐体による干渉を避けるため、屈曲型レンズが採用され、レンズの主点(光軸上の主要な点)が物理的なレンズの外側にくるように設計されている。これにより、各カメラの撮影位置を一点に集約し、合成時の歪みを軽減している。

各カメラは長方形の映像を撮影し、水平方向の視野角(FOV)は82°である。そのうち72°が実際に使用され、残りの10°は映像のオーバーラップ部分となる。5台のカメラの合計画素数は35Kとなるが、重なり合う部分があるため、最終的に30Kの映像として構成される。

この30K360°カメラシステムは、高精細な没入型コンテンツの制作に活用されることを想定している。撮影された360°映像は、ヘッドマウントディスプレイ(HMD)向けにダウンコンバートして利用することも可能だが、現状のHMDでは30Kの解像感を完全に表現できるものは存在しない。例えば、Apple Vision Proの片目8K相当の解像度でも、30Kの映像を忠実に再現するにはまだ足りていない。現在市場に出始めているBlackmagic Immersiveなどの17Kクラスのカメラと比較しても、本システムはより高い画素密度を持つ。

半球ドームで公開されていたコンテンツは、別エリアにて16面湾曲ディスプレイを用いた空間体験コンテンツとしても再提供された。このコンテンツは、映像の垂直方向の動きによって特に浮遊感を作り出し、体験者に高い臨場感をもたらした。また、映像が細部まで鮮明に表現されたことは、高精細映像がもたらす利点を明確に示した。

画面内の領域ごとに画質を調節する新しいカメラ

2025年5月8日に報道発表された「シーン適応型カメラ」の公開は、技研展示における主要な要素であった。このカメラは、広視野角な映像撮影において、画面内の明るい部分と暗い部分、あるいは動きの速い部分と遅い部分など、多様な被写体が混在する状況に対応するため開発された。

本カメラの核心技術は、4Kエリア制御イメージセンサーである。このセンサーは、イメージセンサー全体を4×4画素(16画素)単位の「エリア」に分割し、各エリアの撮影モードを個別に制御することを可能とする。

制御可能な撮影モードは以下の通りである。

- 基本モード:通常の60フレームで撮影するモードである。

- 高速モード:4画素をまとめて読み出すことで、従来の4倍の速さである240フレームでの読み出しが可能となる。動きの速い被写体に対応する。

- 高輝度モード:強い光が当たるエリアでは、電子シャッターを用いて露光時間を240分の1に短縮する。これにより、白飛びを抑制する。

- 低輝度モード:暗いエリアでは、フレームレートを30フレームに落とすことで、より多くの光を蓄積し、明るく撮影する。

これにより、明るい部分では露光時間を短縮し、動きの速い部分ではフレームレートを高くするなど、画面内の各領域において最適な撮影モードを適用することが可能となる。

従来のカメラで広視野角の映像を撮影すると、画面内の明るい部分が白飛びしたり、動きの速い部分がブレて表示されるといった問題が生じる。しかし、シーン適応型カメラでは、上記で述べたエリア制御イメージセンサーにより、明るい部分の白飛びを抑制し、動きの速い部分のブレを軽減した鮮明な映像を同時に取得できる。

技研が公開した比較動画では、通常のモードで撮影した映像と比較して、シーン適応型カメラで撮影した映像では、回転する被写体のブレが低減され、明るい部分の白飛びが抑えられていることが確認された。また、映像全体を240Pで撮影することも可能だが、その場合、全体的にノイズが増加し、輝度が不足するといった課題がある。シーン適応型カメラは、この課題を克服し、全ての領域で最適な撮影モードを適用することで、高画質かつ高フレームレートの映像を実現する。

この技術は、特にスポーツ中継など、日なたと日陰が混在し、明るさのダイナミックレンジが広いシーンでの活用が期待される。従来のカメラでは、日陰部分が黒く潰れたり、日なた部分が白飛びしたりする課題があったが、シーン適応型カメラは、局所的な露出制御によりこれらの問題を解決し、すべての明るさに対して適切な映像表現を可能にする。これは、既存のセンサーのダイナミックレンジ性能に加え、適応的な露光時間制御を組み合わせることで、実質的なダイナミックレンジをさらに高めることに貢献する。

例えば、近年スポーツ中継で評価されている高ダイナミックレンジ対応カメラ(例:ARRI ALEXA 35 Live)は、センサー自体の性能向上により広範なダイナミックレンジを実現している。シーン適応型カメラは、この基本的なセンサー性能に加えて、適応的な動作を組み合わせることで、さらなるダイナミックレンジの拡張を可能にするという点で異なるアプローチをとっている。

本カメラのもう一つの利点は、データレートの効率化である。通常、フレームレートを4倍にするとデータ量も4倍になるが、このセンサーは高速モード時に解像度を1/4に落とすことで、データレートの増加を抑えつつ高速撮影を実現する。

この技術は、既存の技術と組み合わせることで、より高画質で多様な撮影シーンに対応する可能性を秘めている。

つながるメディアアクセシビリティー体験

技研公開2025では、視覚・聴覚障害者、高齢者、外国人など、多様な視聴者へ情報を提供するためのユニバーサルサービスに関する研究が紹介された。技研は、手話CG、解説音声といったメディアアクセシビリティ支援技術の開発を進めており、今回はこれらの技術を統合した音楽連動アクセシビリティアプリが将来的なサービス例として展示された。

このアプリは、インターネット配信技術を利用し、以下の要素を番組コンテンツと連動させる。

- 手話CG:番組内容を手話CGで表示する。

- 解説音声:視覚情報などを音声で補足説明する。

- 字幕:番組のセリフや音情報をテキストで表示する。

- 音楽の可視化:昨年も展示された技術で、音楽を視覚的に表現する。

また、字幕や解説音声の内容は、点字ディスプレイに表示することも可能となっており、視覚障害者への情報提供も考慮されている。これらの統合された機能により、あらゆる人々がコンテンツを楽しめるような未来のメディア体験が提案された。

自由な曲面を可能にするディフォーマブルディスプレイ

技研公開2025のフロンティアサイエンス部門では、場所を選ばずに没入感と臨場感のあるコンテンツを楽しめるよう、柔軟な変形が可能なディスプレイの研究が進められている。

今回、技研はゴム基板上に伸縮性配線とLEDを形成したカラーディフォーマブルディスプレイを展示した。このディスプレイの応用例として、将来的な自動運転車両の車内をディスプレイとして活用する案や、皮膚に密着するウェアラブルディスプレイとしての利用が挙げられている。本ディスプレイは、昨年も展示されたが、今回は画素数が増加し、より精細な映像表現が可能となっている。

放送局データを用いた大規模言語モデル

技研公開2025では、放送局データを用いた大規模言語モデル(LLM)の開発が紹介された。技研は、番組制作過程における様々な業務の効率化を目指し、LLMの開発を進めている。

今回、NHKが放送したニュースなどのデータを学習させた独自のLLMが構築された。このLLMは、番組制作支援ツールとしての実用化にはさらなる改良が必要とされているが、今回はその開発状況と、情報要約や翻訳など、番組制作者をサポートするアプリケーション例が提示された。