txt:山下香欧 構成:編集部

駆使されるバーチャルシネマ撮影とレンダリング技術

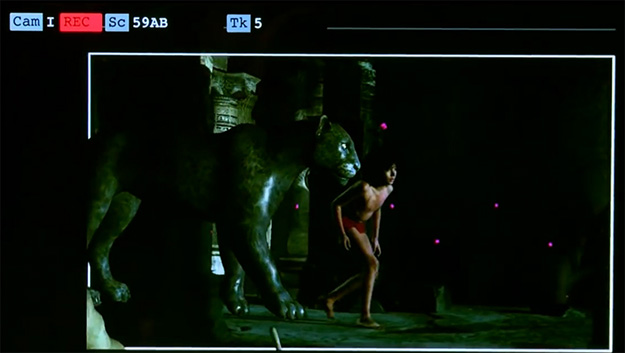

2016年4月15日より全米公開となったジョン・ファヴロー監督のディズニー最新作「ジャングル・ブック」の制作では、オンセットによるバーチャルシネマ撮影とレンダリング技術が駆使された。本作は、屋外での撮影は一切行われず、米ロサンジェルスにあるスタジオ内で行われている。主人公のモーグリ少年以外の生命体は、すべてCGで創られているにも関わらず、スクリーンに映し出されるシーンはリアルスティックなものに仕上がっている。

NAB2016会期中に開催されたセッションCreative Master Seriesで注目度が高かったプログラムの1つ「The Jungle Book”: New technology meets classic storytelling(ジャングル・ブック:新技術とクラシックなストーリーテリングが出会うとき)」では、本作に携わった、視覚効果監督のロブ・レガート氏、プロデューサーのブリカム・テイラー氏、テクニカラーのカラリストマスターのマイク・ゾーヴァ氏が揃い、現場で展開したバーチャルプロダクション技術に纏わるトークが繰り広げられた(ICGマガジン編集のデビッド・ジェフナー氏がモデレーター)。

左からレガート氏、テイラー氏、ゾーヴァ氏

本作のCG制作は、英国ロンドンベースのMPC(The Moving Picture Company、テクニカラーの傘下スタジオ)が、Weta Digitalと一緒に全体の90%以上のアニメーション制作を担当した。そしてCG・VFXプロダクションのデジタルドメインが、レガート氏と共同でバーチャルカメラシステムを構築し、現場でシステムの指導に当たった。800人以上のCGアーティストたちが携わり、54種類もの動物と284セットになった500種類以上の植物を含め、ジャングルという自然環境にあるものがCGで再現された。このため、MPCがインドに持つVFX施設から、ジャングル地域へ実際に行き、10万枚以上の写真をサンプルデータとして収集したという。MPCでは2億4千レンダーファーム時間が費やされ、1984TBものデータが生成された。

ジャングル・ブックの公式トレーラー

レガート氏は、バーチャルシネマ撮影というバーチャルプロダクションについて、マーティン・スコセッシ監督作のアビエイターや、ジェームス・キャメロン監督作のアバターで構想を積み立てていったという。セッション会場では、シーンカットのデモクリップをスクリーンで見せながら、撮影監督ビル・ポープ氏のプロダクションプロセスやライブアクションの撮影の流れなどを説明した。

レガート氏は、「スケッチをして、それを消して、また描き直して」というのと同様に、“(自分の)のクリエイティビティ(創造)は、アナログ思考と行動に基づいている”という。そういったレガート氏の思考の展開はすべて、制作チームが作業しやすくなる、快適な環境をつくるためのツールと方法論を生み出すことにあると話す。

シーンによっては、モーグリと一緒に全部のキャラクター役アクターを揃えて撮影するのではなく、アフレコの声に合わせてパペットを動かすことで(パペットはプレビズを見ながら演技)という、レガート氏の云うアナログ手法を施している

デジタルドメインのバーチャルセットスタジオでは、10歳の俳優ニール・セティ(モーグリ役)やスタント俳優達のモーションキャプチャがなされ、ライブアクションを撮る場でのバーチャルカメラ(シュミレーションカム)の参照データにした。シミュレーションカムのライブフィードは、実写を撮影するALEXAカメラを通して、モーションキャプチャとプレビズをリアルタイムに合成することができる。これによりCGキャラクターとの掛け合いが、現場でモニターを通して確認ができるようになる。

ゲームエンジンのクオリティではあるが、現場のアーティストにも最終的にどのような仕上げになるかを視認してもらえる。CGキャラクターは、最終的にはキーフレームでアニメーション付けをされているが、プレ撮影とポストの垣根がないワークフローを構築した。

ブルースクリーンに囲まれた中、バーチャルカメラを利用することで、ライブアクション(実写)の撮影のように演技を撮っていけたという。この撮影方法は、インタラクティブで現場に柔軟に対応ができる環境を作り、新しいプロダクションパイプラインとなった。

txt:山下香欧 構成:編集部